Kontext je důležitý: trh datové infrastruktury a vybavení překročil v roce 2026 hodnotu 500 miliard USD. AI se stala tématem číslo jedna v earnings calls velkých korporací a datová centra jsou její páteří.

Právě to vysvětluje, proč se celé odvětví mění tak rychle a tak radikálně. Jaké trendy v datových centrech nás tedy čekají podle IoT Analytics?

1. AI workloady tlačí hustotu racků přes 1 MW

Ještě před pěti lety byl standardní rack dimenzován na přibližně 10 kW. Dnes se na výstavišti v Londýně bavíme o megawattech — a debata se vede o tom, co přesně „megawattový rack" vlastně znamená.

Delta Electronics prezentoval UPS třetí generace s výkonovým výstupem 1 250 kW na jeden čtvereční metr. Konzultační firmy přiznaly, že aktivně navrhují 2,2MW racky pro americké klienty s globálními ambicemi a počítají s nasazením do pěti let. NVIDIA připravuje 600kW testovací rack — konkrétně rack označovaný jako Kyber, navržený pro čipy Rubin Ultra — jehož uvedení se očekává kolem léta 2027. Dell prý zkoumá podobné ultra-husté konfigurace.

Chcete dostávat do mailu týdenní přehled článků z Computertrends? Objednejte si náš mailový servis a žádná důležitá informace vám neuteče. Objednat si lze také newsletter To hlavní, páteční souhrn nejdůležitějších článků ze všech našich serverů. Newslettery si můžete objednat na této stránce.

Na druhém konci spektra stojí NVIDIA s avizovanými 5 MW na rack. Zástupce Mitsubishi Electric to komentoval střízlivě: „5MW racky jsou zatím oznámení pro velmi specifické aplikace a specifické GPU. Ale 100 kW na rack bylo před pěti lety šílenství — mezera mezi oznámeními a realitou se postupně zužuje.“

Klíčové je, že tato hustota přestává být záležitostí vzdálené budoucnosti. Stává se parametrem, se kterým musí architekti datových center počítat už při dnešním projektování — i když samotné extrémní hodnoty jsou zatím spíše technologickým horizontem než okamžitou praxí.

2. Kapalinové chlazení přímým kontaktem s čipem se stalo průmyslovým standardem

Ještě nedávno bylo kapalinové chlazení považováno za exotiku pro nejnáročnější hyperscalery. V Londýně 2026 bylo zřejmé, že tato fáze skončila. Direct-to-chip liquid cooling (DLC) se konsoliduje jako nový standard pro AI-centric nasazení — trh přestal experimentovat a začal standardizovat.

Zástupce SWEP to pojmenoval přesně: „Letos vidíme výrazně vyspělejší trh kapalinového chlazení. Standardizuje se. CDU segment enormně vyrostl — spousta výrobců má produkt připravený k prodeji.“

Konkrétní příklady z výstaviště: nVent představil velkokapacitní CDU schopné zvládnout až 1,8 MW digitální zátěže. Jednotky pracují s teplotní deltou čtyř stupňů, což je přímo kompatibilní s referenční architekturou NVIDIA, a jsou vybaveny průběžným monitoringem čistoty chladiva, aby nedocházelo k ucpávání manifoldů.

Produkt vznikl ve spolupráci s Googlem a splňuje standardy Open Compute Project (OCP). Rittal demonstroval 1MW direct-to-chip chladící pod pro clustery AI racků s hustotou až 250 kW na rack — s integrovanými manifoldy, rozvodem výkonu a chlazením v jednom celku.

Důležitá poznámka, kterou sami výrobci zdůrazňují: vzduchové chlazení nezaniká. Pro méně výkonově náročná nasazení a mimo hyperscaler segment zůstane relevantní ještě dlouho. Kapalinové chlazení je imperativem pro nová AI-first datová centra — ne pro celý trh plošně.

3. Průmysl se připravuje na přechod na 800V DC architektury

Každý AC-DC převod znamená ztrátu energie. V tradičním datovém centru jich proběhne hned několik — a při dnešních výkonech to představuje nezanedbatelné množství mařené elektřiny. Řešením je přejít na distribuci stejnosměrného proudu (DC) a konverzi provést jen jednou, na vstupu do budovy.

LS Electric na akci ukázal architekturu 750/800V DC se solid-state transformátorem (SST), který nahrazuje klasické UPS a AC/DC převodníky. Jejich čísla jsou přesvědčivá: celkové ztráty výkonového systému v DC architektuře činí 10 % oproti 25 % u AC. Zástupce firmy popsal situaci takto: „Kdykoli jdu na schůzku s velkými IT firmami, všichni říkají totéž — AC/DC konverze způsobuje ztráty energie. Společná vize je jasná: konverzí musí být méně.“ Firma přitom přiznala, že masové nasazení nepřijde dřív než kolem roku 2030 — standardy se teprve finalizují a bezpečnostní testování si vyžádá čas.

Legrand šel jinou cestou: místo změny celé distribuční architektury centralizoval AC/DC konverzi na úrovni racku pomocí tzv. OCP power trainu. Konverze tak probíhá jednou na úrovni kabinetu, nikoli v každém serveru zvlášť. Výsledkem je možnost dosáhnout kapacity až 300 kW na kabinet a výrazně zvýšit výpočetní hustotu bez zásahu do serverů samotných. Zástupce Legrand to popsal takto: „Dnes je AC/DC konverze v kabinetu. Ale výhled do budoucna je jasný — DC výkon půjde přímo z UPS systému až do kabinetu.“

ABB upozornil, že má v DC technologiích náskok díky desetiletím zkušeností z železnice a námořního průmyslu. Zároveň zdůraznil, že AC infrastruktura nikam nezmizí — standardní cloudové workloady jako Microsoft 365 ji budou využívat i nadále. A co se týče nákladů: při přechodu na DC bude hlavním finančním faktorem nikoli elektrická instalace, ale pokročilé chladicí systémy.

Zástupce Eatonu dodal stručně: „Hlavním motorem je rostoucí výkonová hustota racků. Potřebujete stále více výkonu — a toho dosáhnete jen přes DC.“

4. Software pro správu datových center se konsoliduje do jednotných platforem

Operátoři datových center historicky spravují infrastrukturu přes několik oddělených systémů: BMS (building management system) pro chlazení a budovu, EPMS (electrical power management system) pro rozvod elektřiny a SCADA pro rychlé elektrické přepínání. Výsledkem je fragmentovaný pohled na provoz, kde každý systém mluví jiným jazykem a přechod mezi nimi zpomaluje reakci na incidenty.

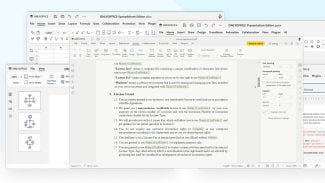

Trend, který byl v Londýně zřetelně vidět, je konsolidace těchto vrstev do jednotných platforem — tzv. single-pane-of-glass přístupu, který propojuje facility management s DCIM (data center infrastructure management).

Schneider Electric na akci představil EcoStruxure Foresight — novou platformu plánovanou k prvnímu vydání v prosinci 2026, která slučuje jejich dosavadní samostatné produkty: EBO (BMS), PME (EPMS) a EPO (SCADA). Operátor tak bude moci sledovat elektrické průběhy a výkon chlazení v jedné aplikaci bez přepínání kontextů. Schneider aktuálně provozuje pět samostatných softwarových nástrojů s IT Advisorem jako zastřešující vrstvou — Foresight má tuto architekturu zásadně zjednodušit.

Mitsubishi Electric jde podobnou cestou: jejich SCADA systém Iconics, který firma akvírovala v roce 2019, je nyní pozicován přímo jako DCIM řešení pro datová centra. K němu Mitsubishi přidává kybernetickou bezpečnost od Nozomi Networks, kterou akvíroval v září 2025 — výsledkem má být komplexní platforma pro dohled i ochranu infrastruktury v jednom.

5. AI datová hustota žene počty optických vláken do extrémů

Přenos dat mezi GPU clustery vyžaduje obrovskou šířku pásma — a fyzické kabely musí tuto realitu zvládnout v čím dál omezenějším prostoru. Výsledkem je trend extrémní hustoty optických vláken, kde tradiční kabely jednoduše nestačí.

Fujikura na výstavišti demonstroval kabel s 13 000 individuálními vlákny v jednom svazku, využívající proprietární technologii „rubbing tube", která vlákna uspořádává do konfigurace připomínající pavučinu. Kabel je určen pro propojení datových center nebo jejich napojení na vnější sítě.

Zástupce firmy vysvětlil logiku: „S AI potřebujeme zpracovávat mnohem více dat v menším prostoru. Naše kabely míří k vysokým počtům vláken.“

Pořizovací lhůta pro high-density optické kabely aktuálně činí 1 až 1,2 roku — a to kvůli surovinové úzkosti: specializované sklo pro tato vlákna vyrábějí celosvětově pouze čtyři společnosti. Tato koncentrace dodavatelského řetězce představuje strukturální riziko, které se při dalším růstu poptávky může snadno prohloubit.

6. Busbary nahrazují tradiční kabeláž v šedém prostoru

Při výkonech v řádu megawattů se tradiční kabeláž stává provozní brzdou. Přidat nové připojení nebo přesunout zdroj výkonu znamená táhnout stometrový kabel od rozvaděče — zdlouhavý, nákladný a fyzicky omezující proces, který v prostředí s rychle se měnícími výkonovými požadavky prostě nefunguje.

Řešením jsou busbary: modulární systémy přívodu výkonu, které fungují jako nepřetržitá lišta s odbočkami. Operátor přidá nové připojení kdekoliv podél trasy bez nutnosti nové kabeláže. Systémy zvládají zátěže až 4 000 ampérů. Konzultanti na akci odhadli, že přibližně 70 % nových projektů datových center dnes využívá busbary v šedém prostoru místo tradičních kabelů — jde o odhad z rozhovorů na místě, nikoli o tvrdou statistiku, ale trend je zřetelný.

Počáteční investice do busbarů je sice vyšší než u klasické kabeláže, ale dlouhodobá provozní flexibilita — zejména v prostředí, kde se výkonové požadavky mění každé dva roky — tuto přirážku snadno ospravedlní. Jak to shrnul jeden z konzultantů: „Busbary vám dají flexibilitu do budoucna. Když potřebujete změnu, vyřešíte ji na liště — nemusíte táhnout 100metrový kabel od rozvaděče.“

7. Připojení k rozvodné síti se stalo největším bottleneckem

Žádný trend není tak přehlížený a přitom tak kritický jako dostupnost sítě. Níže jsou aktuální pořizovací a realizační lhůty sdílené účastníky konference:

|

Kategorie |

Komponenta |

Lhůta |

|

Síť a grid |

Vysokonapěťové připojení k síti |

6–8 let |

|

Kabeláž |

Vysokonapěťové silové kabely |

1,5–2 roky |

|

Elektro |

Transformátory a kritické prvky |

1–1,5 roku |

|

Optika |

High-density optické kabely |

1–1,2 roku |

|

Generátory |

Záložní generátory (motor) |

1 rok |

|

Generátory |

Kontejnerové modulární generátory |

1 rok |

|

Chlazení |

High-density kapalinové chlazení (1 MW) |

0,5 roku |

|

Kabeláž |

Standardní nízko/středonapěťové kabely |

~1 měsíc |

Číslo na prvním řádku tabulky je klíčové: vysokonapěťové připojení k rozvodné síti trvá v přetížených evropských trzích — jako je Frankfurt — 6 až 8 let. To nutí operátory přehodnotit celý model zásobování energií a přejít na vlastní generaci přímo v areálu.

Pište pro Computertrends

Máte dobré nápady, máte co říct? Chcete se podělit o své znalosti se čtenáři Computertrends?

Je tu ideální příležitost. V redakci neustále hledáme externí autory, kteří rozšíří náš záběr. Nabízíme možnost publikací zajímavých článků nejen na webu, ale také v našem tištěném magazínu.

Pokud máte zájem, ozvěte se šéfredaktorovi na e-mail: radan.dolejs@iinfo.cz

Kapalinové chlazení je naopak pozitivním překvapením: přes rychlý růst trhu jsou pořizovací lhůty pro 1MW systémy jen půl roku — výrazně kratší než u těžkých elektrických komponent. Kdo plánuje nové datové centrum, měl by začít od gridu a pracovat zpět: připojení k síti s lhůtou 6–8 let je parametr, který musí být v projektovém plánu jako první — ne jako poslední.

Co z toho plyne

Data Centre World London 2026 ukázal odvětví v přechodové fázi — od infrastruktury navržené pro tradiční IT workloady k infrastruktuře primárně dimenzované pro AI. Změny nejsou postupné, jsou systémové: týkají se fyzického designu hal, elektrické architektury, chlazení, kabeláže i softwaru pro správu.

Tři věci jsou přitom zřejmé. Za prvé, extrémní hustota racků není sci-fi — je to inženýrský problém, který se řeší dnes a jehož dopady (na chlazení, elektriku, software) jsou propojené. Za druhé, dodavatelský řetězec je křehčí, než se zdá: čtyři výrobci skla pro optická vlákna, transformátory s osmnáctiměsíční lhůtou a grid s osmiletou čekací dobou jsou strukturální rizika, nikoli dočasné výkyvy. Za třetí, konsolidace softwaru a přechod na DC architektury jsou trendy s jasným směrem, ale s horizontem kolem roku 2030 — kdo začne s piloty dnes, bude mít při masovém nasazení náskok.

Computertrends si můžete objednat i jako klasický časopis. Je jediným odborným magazínem na českém a slovenském trhu zaměreným na profesionály v oblasti informačních a komunikačních technologií (ICT). Díky silnému zázemí přináší aktuální zpravodajství, analýzy, komentáře a přehledy nejnovejších technologií dříve a na vyšší odborné úrovni, než ostatní periodika na tuzemském trhu.

Obsah Computertrends je určen odborníkům a manažerům z firem a institucí, kteří se podílejí na rozhodovacím procesu při nákupu ICT technologií. Jednotlivá čísla si můžete objednat i v digitální podobě.